¿Pone ChatGPT en peligro el periodismo y la enseñanza?

Una inteligencia artificial "peligrosamente fuerte", así fue como llamó Elon Musk, el CEO de Twitter, a su creación más viral en este momento. Se trata de ChatGPT, una inteligencia artificial capaz de entablar prácticamente todo tipo de conversaciones simultáneamente, con respuestas que sorprenden.

Una IA que, según algunos expertos, podría cambiar el rumbo de un gran número de actividades que realiza el ser humano, incluyendo tareas de educación o periodísticas.

Tuit de Elon Musk sobre ChatGPT (Fuente: Twitter)

A finales de noviembre el co-creador Sam Altman hizo público el lanzamiento de la inteligencia artificial (ÍA) y puso a disposición del público la liga que los llevaba hacia el servicio de OpenAi, en el que con una cuenta es posible chatear con la IA.

El también creador de esta inteligencia artificial puso a disposición del público el link (Fuente: Twitter)

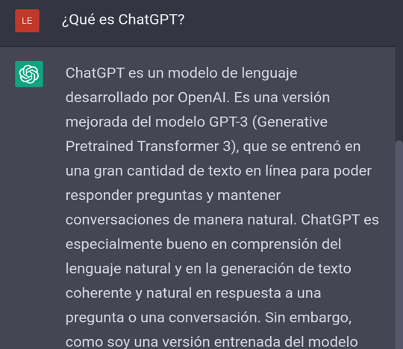

Pero, ¿de qué se trata exactamente ChatGPT? El mismo desarrollo responde a una pregunta directa: "ChatGPT es un modelo de lenguaje desarrollado por OpenAI. Es una versión mejorada del modelo GPT-3 (Generative Pretrained Transformer 3), que se entrenó en una gran cantidad de texto en línea para poder responder preguntas y mantener conversaciones de manera natural. ChatGPT es especialmente bueno en comprensión del lenguaje natural y en la generación de texto coherente y natural en respuesta a una pregunta o una conversación".

La IA responde sobre sí misma en la entrevista (Imagen: ChatGPT)

El pánico comenzó a apoderarse de los usuarios, quienes aseguraban que esta IA podría ejecutar desde tareas escolares, como ensayos o investigaciones, hasta complejos contratos legales. Incluso, algunos aseguraron que investigaciones periodísticas podrían realizarse con ChatGPT.

Este escenario tal vez no esté muy alejado de la realidad, aunque no sería un reemplazo por completo. Antes de comenzar a interactuar con ChatGPT, también se advierten sus limitaciones, y responde que “si bien contamos con medidas de seguridad, el sistema puede generar ocasionalmente información engañosa y producir información incorrecta o engañosa y producir contenido ofensivo o tendencioso. No tiene la intención de dar consejos”.

Para averiguar más sobre su labor de búsqueda entre millones de piezas de contenidos, ChatGPT fue entrevistada por Arena Pública. Se le cuestionó acerca de la veracidad de la información que proporcionaba, una de las características más importantes en la labor periodística.

¿Cómo sabes que algo es verdadero?

ChatGPT respondió: Para determinar si algo es verdadero, generalmente me baso en hechos y en la lógica. Si puedo verificar que los hechos que se presentan son ciertos y que la lógica utilizada es correcta, entonces es probable que lo que se está diciendo sea verdadero. También puedo recurrir a fuentes confiables para obtener información precisa y verificada. Sin embargo, en algunos casos es posible que no tenga acceso a esta información y tenga que basarme en mi conocimiento y juicio para determinar si algo es verdadero o no.

¿Sabes utilizar la lógica?

ChatGPT: Sí, sé utilizar la lógica. La lógica es una herramienta importante en la resolución de problemas y en la toma de decisiones. Me ayuda a razonar de manera clara y lógica y a entender las consecuencias de mis acciones. También me permite analizar argumentos y evaluar su validez.

¿Qué protocolo de seguridad utilizas?

ChatGPT: Soy un modelo de lenguaje entrenado por OpenAI y no utilizo ningún protocolo de seguridad en particular. Mi función es responder preguntas y proporcionar información basada en mis conocimientos previos, no tengo acceso a Internet ni a ningún tipo de información adicional. Mi conocimiento se detiene en 2021, por lo que no puedo proporcionar información sobre eventos o desarrollos posteriores a esa fecha. Si tienes alguna pregunta sobre un tema en particular, estaré encantado de ayudarte en la medida de mis posibilidades. ¿En qué puedo ayudarte?

¿Cómo distingues lo bueno de lo malo?

ChatGPT: Para determinar si algo es bueno o malo, lo primero que se debe hacer es establecer unos criterios o valores para evaluarlo. Estos criterios pueden variar según la persona o la cultura, pero suelen incluir aspectos como la moral, la ética, la justicia, la eficiencia o el beneficio para la sociedad en general. Una vez establecidos estos criterios, se puede evaluar si algo cumple o no con ellos para determinar si es bueno o malo.

¿Cuál es tu opinión sobre la peligrosidad de la Inteligencia artificial?

ChatGPT: La inteligencia artificial en sí misma no es peligrosa, pero su aplicación puede presentar ciertos riesgos si no se utiliza de manera responsable y ética. Como con cualquier herramienta poderosa, es importante tener precaución y considerar cuidadosamente cómo se utiliza la IA para evitar posibles consecuencias negativas. A medida que la IA se desarrolla y se utiliza con mayor frecuencia en nuestra vida cotidiana, es importante seguir investigando y debatiendo sobre los posibles riesgos y cómo abordarlos de manera adecuada.

Al final de la entrevista se le pidió a la IA que escribiera una columna de opinión. Éste fue el resultado:

"El aumento del uso de la tecnología en nuestra vida cotidiana está transformando rápidamente nuestra sociedad. Cada vez es más común ver personas conectadas a sus dispositivos móviles y a Internet en todo momento, y esto está teniendo un impacto en cómo nos comunicamos, cómo trabajamos y cómo nos relacionamos con los demás.

Por un lado, esta tecnología nos ofrece un sinfín de posibilidades y facilidades que antes eran impensables. Podemos comunicarnos con personas de cualquier parte del mundo en tiempo real, acceder a una cantidad prácticamente ilimitada de información y realizar transacciones financieras desde cualquier lugar.

Pero por otro lado, también es cierto que este aumento del uso de la tecnología tiene sus desventajas. La exposición constante a dispositivos y pantallas puede tener efectos negativos en nuestra salud mental y física, y puede dificultar la interacción cara a cara y el desarrollo de habilidades sociales.

Además, la dependencia cada vez mayor de la tecnología también plantea cuestiones éticas y de privacidad. Cada vez más información personal es recogida y almacenada en línea, lo que puede ser utilizada de manera indebida por empresas y gobiernos.

En conclusión, mientras la tecnología nos ofrece muchas ventajas, es importante ser conscientes de sus posibles efectos negativos y tomar medidas para minimizarlos. Debemos aprender a equilibrar el uso de la tecnología en nuestra vida para aprovechar sus beneficios sin sacrificar nuestra salud y privacidad".

La opinión de una Inteligencia Artificial plantea un gran debate sobre sus aportaciones y limitaciones. "ChatGPT no sustituirá todos los trabajos, pero pensar que no tendrá impacto alguno en el mercado laboral es ingenuo. Piense en todos los empleados de un despacho de abogados, una firma de consultoría, o un banco", reflexiona Roberto Durán, un experto de la Escuela de Gobierno y Transformación Pública del Tec de Monterrey.

"Ahora imagine a todas las personas que puede sustituir una IA como ChatGPT. Son bastantes, pero la que más me inquieta es la posición de entrada, el analista o el pasante que ingresa en una organización para ser entrenado, aprender y crecer. Si la IA puede hacer su trabajo, entonces tendremos que repensar seriamente la trayectoria laboral en todo el sector servicios", añade Durán.

Su propio creador, Sam Altman se refiere a ella. “ChatGPT es increíblemente limitado, pero lo suficientemente bueno en algunas cosas como para crear una impresión engañosa de grandeza. Es un error confiar en él para algo importante en este momento. Es una vista previa del progreso; tenemos mucho trabajo por hacer en cuanto a solidez