Acusan tecnológicas “freno de innovación” ante regulación

La regulación en inteligencia artificial comienza a incomodar a gigantes tecnológicos.

Meta, Spotify y OpenAI advirtieron un “freno” en el avance de la innovación de desarrollos de inteligencia artificial (IA) frente a regulaciones de la Unión Europea y en Estados Unidos, que las acusan de “fragmentadas”, plagadas de “implementaciones inconsistentes”.

Ambas empresas señalaron en un comunicado que las leyes diseñadas para aumentar la soberanía y la competitividad europeas están logrando lo contrario, e instan a Europa a simplificar y armonizar las regulaciones aprovechando los beneficios de un mercado único pero diverso.

Jersain Llamas, abogado experto en regulación tecnológica, explica que las empresas tecnológicas se encuentran en un momento de intersección entre diferentes normatividades, y la preocupación expuesta por los directivos refleja una realidad en el marco regulatorio de la Unión Europea.

"Si bien el Reglamento General de Protección de Datos (RGPD) sí establece principios fundamentales para el tratamiento de datos personales, en sentido estricto no hay una normativa específica para este tipo de datos públicos. Si bien la Ley de Inteligencia Artificial de la Unión Europea en su estado actual es una normativa basada en niveles de riesgo, no especifica de manera exahustiva cómo se debe gestionar el acceso a los datos", dijo en entrevista.

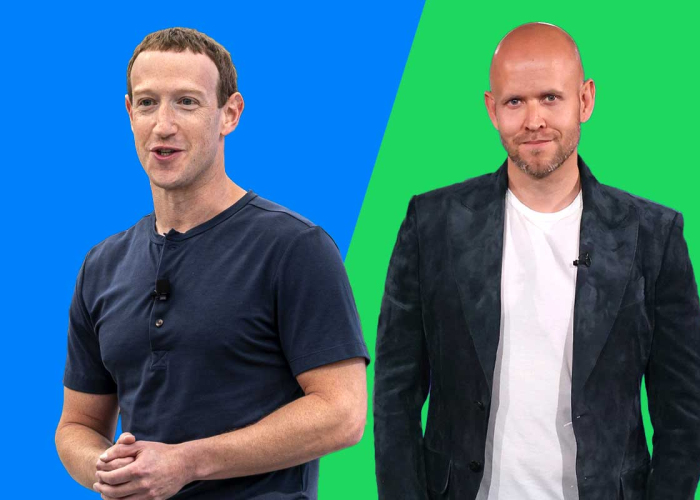

Las críticas del CEO de Meta, Mark Zuckerberg, y el de Spotify, Daniel Ek, señalaron también que las regulaciones de la Unión Europea (UE) limitan el desarrollo de IA de código abierto, y a su vez, dijeron que las estrictas normativas de privacidad impiden a Meta entrenar sus modelos de IA con datos públicos de Facebook e Instagram, lo que podría dejar a Europa rezagada en el acceso a tecnologías avanzadas.

Esta situación podría derivar en que los europeos se vean forzados a utilizar productos de IA "diseñados para otros", debido a que el entrenamiento no accederá a conocimiento, cultura e idioma en Europa, según lo expusieron.

“Tomemos como ejemplo la aplicación desigual del Reglamento General de Protección de Datos de la UE . Esta directiva histórica tenía por objeto armonizar el uso y el flujo de datos, pero en lugar de ello los reguladores de privacidad de la UE están creando retrasos e incertidumbre y no son capaces de ponerse de acuerdo entre ellos sobre cómo debería aplicarse la ley”, se lee en el comunicado.

Además, explican que se le ha pedido a Meta que retrase el entrenamiento de sus modelos sobre el contenido compartido públicamente por adultos en Facebook e Instagram, “no porque se haya violado ninguna ley, sino porque los reguladores no se han puesto de acuerdo sobre cómo proceder”, aseguran.

Señalan que, a corto plazo, retrasar el uso de datos que se utilizan rutinariamente en otras regiones significa que los modelos de IA más potentes no reflejarán el conocimiento, la cultura y los idiomas colectivos de Europa, y los europeos no podrán utilizar los productos de IA más recientes.

Por su parte, Spotify señaló cómo su éxito inicial se debió en gran medida a su capacidad para personalizar la experiencia del usuario mediante el uso de IA. El comunicado explica que una estructura regulatoria más simplificada no solo aceleraría el crecimiento de la IA de código abierto, sino que también apoyaría a los desarrolladores europeos y al ecosistema creativo más amplio.

Ante la posibilidad planteada acerca de que las regulaciones pudieran frenar la innovación tecnológica, Llamas Covarrubias opina que la normatividad pone reglas, pero a largo plazo, la protección es necesaria para todos los usuarios.

"Retener el lanzamiento de modelos de Inteligencia Artificial puede percibirse como un freno a la innovación, pero aquí el punto medular es un equilibrio entre la protección de los derechos fundamentales como la privacidad de la protección de datos personales, la intimidad, el derecho al reconocimiento, a la verdad y al derecho tecnológico", dijo en entrevista.

Laura Coronado, abogada experta en cultura digital y regulación tecnológica, converge en que la regulación es adecuada cuando intercala las ambiciones de ambos puntos, pese a que las empresas tecnológicas perfeccionen sus productos con la cantidad de información que manejan.

“La regulación sí es adecuada, de hecho, promueve la innovación porque da reglas claras sobre autoría, privacidad, costos, derechos y obligaciones de los usuarios y de las plataformas. Deberíamos encontrar un punto más equilibrado, un esquema que pague derechos de autor, como lo hace Spotify, y que los usuarios definan si quieren compartir sus datos y tener servicios abiertos o privilegiar la protección de datos y tener un sistema de suscripción”, dijo en entrevista.

Además, opina que el problema es la “inexistencia de regulación” que deja de lado a los innovadores jóvenes o que quieren empezar sin pertenecer a los grandes corporativos porque éstos tienen más poder económico y no los dejan entrar al mercado. “Una mala regulación se convierte en una camisa de fuerza y los innovadores buscan otros sectores menos acartonados”, señala en entrevista.

Spotify y Meta no son las únicas empresas que han tomado una postura diferente a la regulación. Simultáneamente, en Estados Unidos, OpenAI manifestó su oposición a la Ley SB 1047 en California, que busca regular el desarrollo y despliegue de modelos de IA.

Jason Kwon, director de estrategia de OpenAI, argumentó que esta legislación estatal podría frenar el progreso en el sector y llevar a los ingenieros y empresarios a abandonar California en busca de entornos más favorables para la innovación, según lo reportado por Techcrunch.

En su carta dirigida al senador Scott Wiener, promotor de la ley, Kwon defendió que la regulación de la IA debe ser gestionada a nivel federal para evitar la fragmentación y proteger la ventaja competitiva de Estados Unidos en el campo de la inteligencia artificial.

La molestia de las gigantes tecnológicas sucede en un contexto de escrutinio hacia las gigantes tecnológicas en materia de monopolios y protección de datos personales. Meta decidió no lanzar su modelo multimodal Llama en la UE, en respuesta a los requisitos del Reglamento General de Protección de Datos (RGPD). Esta decisión sigue el ejemplo de Apple, que el mes pasado anunció que no introduciría algunas de sus nuevas funciones de inteligencia artificial en la UE, citando preocupaciones relacionadas con el cumplimiento de la Ley de Mercados Digitales (DMA).

Desde su perspectiva, Jersain Llamas opina que en este tenor, una normativa clara que ofrezca tanto seguridad jurídica como mecanismos de supervisión adecuados podrá ser fundamental para no detener el progreso mientras se resguardan los derechos de todas las personas. "Es necesario encontrar un equilibrio donde la innovación no se va paralizada por la incertidumbre regulatoria pero tampoco se sacrifiquen los principios de privacidad", señaló.