Algoritmos, cumplimiento y rendición de cuentas

Un algoritmo no es más que un “conjunto ordenado y finito de operaciones que permite hallar la solución de un problema.”1

De esta forma, aunque normalmente el concepto se ha relacionado con su uso en programas de cómputo, el ser humano ha desarrollado un vasto cúmulo de algoritmos en la historia de la humanidad. Sin embargo, los avances tecnológicos y el desarrollo de la inteligencia artificial (IA) a través del uso técnicas de datos de “auto aprendizaje” ha resultado en que el diseño de los algoritmos transcienda de manera determinante en nuestra vida diaria.

En efecto, cuando utilizamos plataformas digitales para hacer búsquedas, contratar servicios, hacer transacciones financieras, seleccionar contenidos audiovisuales o, incluso, hacer ejercicio, estamos arrojando al ciberespacio un importante volumen de datos que, ordenados y analizados por un algoritmo, pueden no sólo anticipar nuestro comportamiento sino, incluso, modificarlo.2 De esta forma, el diseño de los algoritmos puede no ser neutral y servir para alcanzar objetivos inaceptables para una sociedad tanto desde la perspectiva legal como ética.3

Asimismo, con el desarrollo de “Internet de las Cosas”, el diseño de los algoritmos de respuesta de los diferentes productos requiere elegir entre opciones que pudieran implicar decisiones “éticas” para solucionar problemas de uso. El ejemplo más utilizado para explicar este tipo de decisiones es el del auto autónomo que ante una colisión inminente deberá de elegir la reacción que menos daño cause atendiendo a una serie de valoraciones en las que pudiera haber diferentes opiniones (por ejemplo, enfrentar la disyuntiva entre salvar la vida de un bebé o de un joven).4

Tomando en cuenta la potencialidad y repercusiones de los algoritmos en los diferentes aspectos de la vida social, comercial, laboral y política de los seres humanos es que las naciones se han preocupado en analizar la necesidad de adoptar principios que regulen su diseño y que permitan la vigilancia de los sistemas de IA programados en base a éstos.

En este contexto el pasado 8 de abril de 2019, un grupo de expertos de alto nivel formado por la Comisión Europea emitió un documento que contiene “Directrices éticas para una IA fiable” (Directrices CE)5

Como primer punto, las Directrices CE anotan tres aspectos que toda IA deberá satisfacer durante toda su vida útil: legalidad, ética y robustez. Así, basada en estos tres aspectos las Directrices CE desarrollan 7 requisitos para considerarla fiable y presenta un proceso piloto para que los agentes económicos puedan hacer la evaluación de la IA a la luz de los requisitos enumerados.

Tomando en cuenta la potencialidad y repercusiones de los algoritmos en los diferentes aspectos de la vida social, comercial, laboral y política es que las naciones deben adoptar principios que regulen su diseño y permitan la vigilancia de los sistemas de Inteligencia Artificial

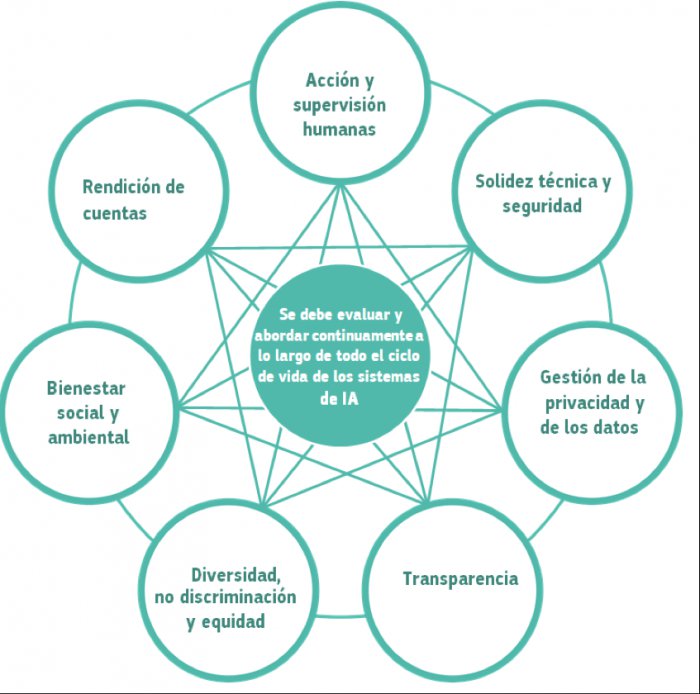

Los requisitos propuestos por la Directrices CE, mismos que deben ser evaluados constantemente, son los siguientes:

1. Acción y supervisión humanas.- La IA debe descansar en la autonomía humana. La autonomía humana no debe ser manipulada por la IA. Los humanos deben ser capaces de intervenir y vigilar todas las decisiones que haga el programa.

2. Solidez técnica y seguridad.- La IA debe ser segura y precisa. Su integridad no debe ser fácilmente comprometida por ataques externos y debe ser razonablemente confiable.

3. Gestión de la privacidad y de los datos.- La recolección de información personal por parte de la IA debe ser segura y mantenerse privada. No debe ser obtenida por cualquiera ni fácilmente robada. Con ello, se debe garantizar el respeto de la privacidad, la calidad y la integridad de los datos, así como el acceso a éstos.

4. Transparencia.- Los datos y algoritmos usados para crear el sistema de IA debe ser accesible y las decisiones de los sistemas deben ser “entendibles y trazables por seres humanos”. En otras palabras, los operadores de los sistemas deben ser capaces de explicar la decisión hecha por la IA.

5. Diversidad, no discriminación y equidad.- Los servicios prestados por la IA deben estar disponibles a todos, sin discriminar por edad, sexo, raza y otras características garantizando la accesibilidad y el diseño universal. Igualmente, asegurar ausencia de sesgos injustificados.

6. Bienestar social y ambiental.- Los sistemas deben ser sustentables (i.e responsables ecológicamente) y tener un impacto social positivo.

7. Rendición de cuentas.- Los sistemas deben ser auditables y cubiertos por la protección existentes en los programas de cumplimiento para “los informantes” (whistleblowers). Impactos negativos de los sistemas deben ser hechos del conocimiento y reportados con anticipación.

Ilustración: Interrelación entre los 7 requisitos

Fuente: página 18 de la versión de las Directrices CE en español.

Igualmente, el pasado 22 de mayo de 2019, 42 países (incluyendo México)6adoptaron la Recommendation of the Council on Artificial Intelligence Organización para la Cooperación y el Desarrollo Económicos (OCDE) (Recomendación OCDE)7 mismas que coinciden sustancialmente con las Directrices CE8 y recomiendan a los gobiernos:

(i) facilitar la inversión pública y privada en la investigación y desarrollo que estimule la innovación en una IA fiable; (2) fomentar ecosistemas de IA accesibles con tecnologías e infraestructuras digitales y mecanismos para el intercambio de datos y conocimiento; (3) desarrollar un entorno de políticas que allane el camino para el despliegue de unos sistemas de IA fiables; (4) capacitar a las personas con competencias de IA y apoyar a los trabajadores con miras a una transición equitativa; y (5) cooperar en la puesta en común de información entre países y sectores, desarrollar estándares ya asegurar una administración responsable de la IA

En ese mismo sentido, el 9 de junio del 2019, los miembros del G-20 adoptaron principios para la IA que fueron delineados a partir de la Recomendación OCDE.9

Si bien, tanto las Directrices CE como la Recomendación abordan los requisitos preminentemente desde una perspectiva ética y de filosofía social, en ambos documentos se refieren a la atribución de responsabilidad legal al subrayar la importancia de que sean las personas (físicas o morales) las que en todo momento sean responsables de la supervisión humanas, transparencia y rendición de cuentas de la operación de los sistemas de IA.

En efecto, este reconocimiento tiene trascendencia legal que no es ajena a nuestro marco jurídico que ya incorpora conceptos complejos para atribución de responsabilidad subjetiva y objetiva.

Esta manifestación cobra mayor importancia ante la preocupación de que la IA “auto aprende” de tal forma que a partir de la experiencia de juegos repetidos ésta pudiera tomar “iniciativas” propias sin intervención humana, cuestionando sobre si los efectos de sus “decisiones” debieran ser imputables a persona jurídica alguna.

Por ejemplo, en el caso de la materia de competencia económica, existe la discusión sobre si el marco legal está preparado para afrontar los retos derivados de potenciales colusiones de agentes económicos a través de algoritmos. Esto sucedería si dos plataformas a través de sus algoritmos “fijan” los mismos precios de tal manera que eliminan la competencia entre ellas.

Veamos, si los agentes económicos acuerdan tácita o expresamente el diseño de un algoritmo que lleve a ese resultado, estaríamos indudablemente frente a una práctica monopólica absoluta tipificada en la Ley Federal de Competencia Económica.

En este caso, la dificultad vendría en la detección de la práctica y en la comprobación de la existencia del acuerdo tácito o expreso entre agentes económicos. Igualmente, la dificultad derivaría de la necesidad de contar con expertos que pudieran entender y auditar el diseño de los algoritmos y su funcionamiento para poder corroborar la colusión. Sin embargo, esto sería un problema práctico y de capacidades probatorias más que de tipificación y responsabilidad de la conducta.

Pero ¿qué pasaría si los algoritmos aprenden y se coluden sin voluntad humana de hacerlo? ¿es posible que los algoritmos decidan solos coludirse entre ellos? ¿es posible entonces excluir de responsabilidad a los agentes económicos que crearon los sistemas?

Precisamente en estos supuestos en que cobran relevancia los requisitos identificados en las Directrices CE y la Recomendación OCDE. En efecto, los algoritmos son diseñados y creados por humanos -o entidades jurídicas administradas por humanos- quiénes deben de prever los efectos de su programación, igualmente, son los humanos los que deben supervisar a la IA y no al revés. De esta manera, el humano debe poder intervenir en cualquier decisión de la IA y hacerse legalmente responsable por los efectos de los sistemas de IA.

¿Qué pasaría si los algoritmos aprenden y se coluden para fijar precios, sin voluntad humana de hacerlo? ¿es posible entonces excluir de responsabilidad a los agentes económicos que crearon los sistemas?

Sin duda, México ha dado un importante paso al suscribir las Recomendaciones de la OCDE y participar en la emitidas en el seno del G-20; ahora debe de tomar las acciones específicas recomendadas en los documentos respectivos. Quizás, aún no alcanzamos a dimensionar los escenarios legales o dilemas éticos que enfrentaremos en el futuro con motivo del desarrollo de la IA.

Sin embargo, es claro que debemos exigir que los sistemas de IA cumplan con requisitos mínimos que aseguren la trazabilidad de sus decisiones. Igualmente, necesitamos expertos que nos permitan monitorearlas, descifrarlas e intervenir los sistemas cuando sea necesario.

Ahora bien, a partir de lo anterior cabe hacerse las siguientes preguntas ¿quién dentro del Gobierno está liderando esta agenda? ¿tenemos como país una agenda comprensiva? ¿están identificados y convocados en los esfuerzos respectivos todos los actores relevantes?

Sin duda, en países como México, lo urgente hace que perdamos atención en lo importante. No obstante, no podemos quedar ajenos a estos retos globales y dejar que el destino nos alcance.

@L0jeda

[1] https://dle.rae.es/

[2] Por ejemplo, véase el caso de Cambrige Analytica quien ha sido señalada de obtener información privada de particulares para poder dirigir mensajes que pudieran influir su voto durante el proceso electoral en Estados Unidos que llevó al triunfo a Donald Trump y el referéndum del Brexit. Véase por ejemplo, https://politicsandinsights.org/2018/03/18/cambridge-analytica-the-commodification-and-marketisation-of-democracy/

[3] Por, ejemplo, en el caso de la legislación en materia de competencia económica, a través del diseño de algoritmos las empresas podrían manipular los precios de venta de bienes o servicios extrayendo rentas extra normales de los consumidores.

[4]Véase por ejemplo https://elpais.com/elpais/2018/10/24/ciencia/1540367038_964708.html

[5] https://ec.europa.eu/digital-single-market/en/news/ethics-guidelines-trustworthy-ai

[6]https://www.oecd.org/centrodemexico/medios/cuarentaydospaisesadoptanlosprincipiosdelaocdesobreinteligenciaartificial.htm

[7] https://legalinstruments.oecd.org/en/instruments/OECD-LEGAL-0449

[8] . En efecto, la Recomendación OCDE coinciden en que los sistemas de IA (i) deben estar al servicio de las personas y del planeta; (ii) deben de diseñarse de manera que respeten el Estado de derecho, los derechos humanos, los valores democráticos y diversidad; (iii) estar presididos por la transparencia y divulgación responsable y (iv) han de funcionar con robustez, de manera fiable y segura. La Recomendación OCDE también establece que las organizaciones y personas que desarrollen, desplieguen y gestionen los sistemas deberán responder de su correcto funcionamiento.

[9] https://g20trade-digital.go.jp/dl/Ministerial_Statement_on_Trade_and_Digital_Economy.pdf

Lucía Ojeda

Abogado por el Instituto Tecnológico Autónomo de México; es profesora de asignatura en el Centro de Investigación y Docencia Económicas y socia de SAI Derecho & Economía. Es especialista en el área de competencia económica y mercados regulados. Ha publicado diversos artículos de análisis y opinión. Fue asesora legal del gobierno de México y secretaria técnica del equipo de negociación en materia de inversión durante las negociaciones del Tratado de Libre Comercio de América del Norte.

Lucía Ojeda

Abogado por el Instituto Tecnológico Autónomo de México; es profesora de asignatura en el Centro de Investigación y Docencia Económicas y socia de SAI Derecho & Economía. Es especialista en el área de competencia económica y mercados regulados. Ha publicado diversos artículos de análisis y opinión. Fue asesora legal del gobierno de México y secretaria técnica del equipo de negociación en materia de inversión durante las negociaciones del Tratado de Libre Comercio de América del Norte.